618的风刮到了大模型圈。仅仅一周,大模型从“厘”时代跨入了“免费”时代。

据统计,此次降价潮共涉及21款大模型厂家。从手机大战、网约车大战、共享单车大战、社区团购大战,再到后来的造车大战和如今的大模型大战。热闹的大模型降价潮是否能再次“便宜”消费者?中小企业、云厂商、大模型厂家,谁才是真正的赢家?

而随着降价潮带来的推理成本的降低,大模型商业化的进程也许加速C端应用的爆发。

大模型有免费午餐吗

谁也没想到,大模型降价潮的多米诺首先被一家小公司推开了。

5月6日,幻方旗下DeepSeek发布的DeepSeek-V2,其价格为GPT-4-Turbo的近百分之一。5月11日,智谱AI大模型开放平台也将入门级产品GLM-3 Turbo模型调用价格下调80%。

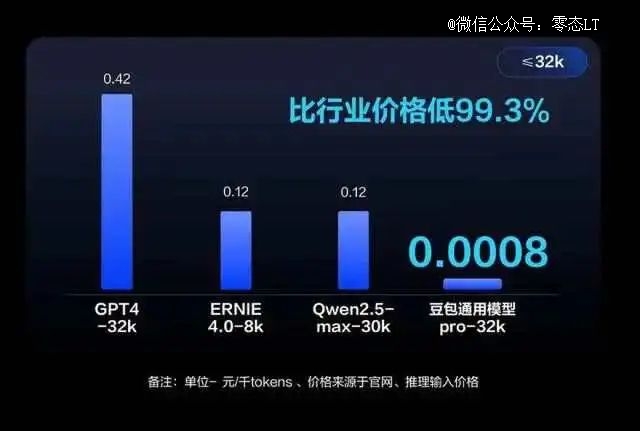

国内大模型厂商价格战随即开启。5月15日,在春季火山引擎Force原动力大会上,字节主力模型在企业市场定价只有0.0008元/千Tokens,比行业价格低99.3%,让大模型从“以分计价”进入到“以厘计价”阶段。

其他大厂纷纷跟进,5月21日,阿里云宣布将旗下通义千问的多款商业化及开源模型进行大幅降价,其中对标GPT-4的商业化模型Qwen-Long的API输入价格从0.02元/千Tokens降至0.0005元/千Tokens,下降97%;输出价格从0.02元/千Tokens降至0.002元/千Tokens,下降90%。同时,百度智能云也发布公告称,百度文心大模型的两款主力模型ENIRESpeed、ENIRElite将全面免费,并立即生效。

▲图:火山引擎Force原动力大会内容

腾讯、科大讯飞等厂商也宣布降价。科大讯飞宣布讯飞星火API能力正式免费开放,讯飞星火Lite API*免费开放,顶配版(Spark3.5 Max)API价格为0.21元/万Tokens。

又是降价,又是免费,“亏本买卖”的厂商们是要把大模型推向免费时代吗?

仔细分析下,率先降价的豆包大模型只是降低输入价格,输出价格降幅并不明显。阿里云降低了输入和输出价格,但Qwen-Max的输出价格并没有降低,这是千问系列当中参数规模*、成本最高的模型,百度降低了也是两款参数规模较小的模型,文心4.0并不在此次降价范畴。大幅降价的都是小规模模型,虽然对外声称水平可以对标GPT-4,但实际上连GPT-3.5都不如,模型水平不达标,根本无法在实际的生产环境中运行。

▲图:百度文心大模型降价产品信息

降价的诚意让人怀疑,看上去像拿几个不好吃的小菜出来,还声称可以免费吃饭。难怪网友怀疑,大模型企业把开发者和企业吸引过来使用,也许就要开始卡调用速度、推理速度、任务处理量等关键指标了。“逼你变成vip,再逼你成为svip”的套路很让人熟悉。

降价只是简单的市场策略

目前,AIGC产业的商业模式主要包括按调用量收费、SaaS(Software as a Service)订阅收费、增值服务和解决方案等多种形式,覆盖了从内容生产公司到普通消费者的广泛客户群体。

以OpenAI为例,其主要收入来源有三:一是针对C端的会员收取订阅服务费用;二是为企业端开发者提供API调用服务,通过付费接入OpenAI端口后,B端用户可在金融、医疗、绘画等领域调用GPT系列大模型、DALL·E系列文生图模型、Whisper语音识别模型进行应用开发,这也是OpenAI最核心的业务;三是来自微软Azure云服务的分成。凭借这三项主要业务,2023年OpenAI收入突破了13亿元。

由于处于相同的赛道,目前国内大厂的收费模式也基本类似于OpenAI,但无论是C端还是B端,国内大模型发展的瓶颈早已是现实。大模型推理价格的降低,主要是因为各个厂商为了抢占市场份额、加速商业化进程。

一个现实是,国内大模型的使用人数还是太少且用户增长乏力,使用数据不够丰富。其次,国内大模型在应用层面,即基于AIGC应用端的用户数量也不高。因此,通过免费扩大用户规模,增加用户交互和训练数据是这次价格战的主要目标。

市场普遍认为,价格战的本质是国内大模型技术差异不大,用户难以感知技术上的区分。互联网大厂通过雄厚的资金,快速削弱和踢出资金实力薄弱的公司。从当年的手机大战、网约车大战、共享单车大战、社区团购大战,再到后来的造车大战都是相似的套路,背后都是技术差距过小导致的。

但大模型“价格战”不只是简单的市场竞争策略。不少人认为,降价标志着国产大模型发展的商业化拐点已到。申万宏源研究所信息化研究部总监、TMT行业首席分析师刘洋在公开采访中表示,国内大模型企业重视产业价值优于财务价值,用户端以及增值版本已经到了可以大规模推广的时候。科大讯飞在发布会中表示,当前公司基于国产自主可控大模型工程化优势,讯飞星火API能力正式免费开放,有利于帮助开发者降低调用成本,驱动产品创新验证,加速大模型赋能及AI普惠化的到来。

人类每一次技术进步的结果,就是技术成本的不断降低,大模型同样遵循着一种“摩尔定律”和规模效应。OpenAI等国外公司早已率先实现了降价,模型能力和算力成本的双重困境下的国内大模型敢于降价,未尝不是算力成本下降的结果。

对于坚持做大模型的云厂商来说,抢占市场份额之外,更大的算盘其实在公有云市场。

公有云是大模型的技术基础。OpenAI发布4o大模型后,引起了社交媒体的一段鼓吹,但亦有专业人士指出,基于Transformer架构下的ChatGpt如果一直依赖公有云,就必然要面对大量用户使用时低延迟无法得到满足的现实。

公共云在生成式人工智能时代神经网络和启动机器般基石作用的体现。因此,大模型行业的快速发展,公有云仍然是巨大的获利方。如果大模型应用真正爆发,AI推理市场也将迎来爆发,打造了具有基座大模型能力的公共云厂商,通过公共云+API的模式,才能走出新的增长曲线,获取更大的盈利空间。以阿里云为代表的云计算厂商,通过从底层算力、AI平台再到模型服务的不断创新,同时AI也反哺了云从管理、应用、计算、基础架构能力的提升。

枪响之后,谁是赢家

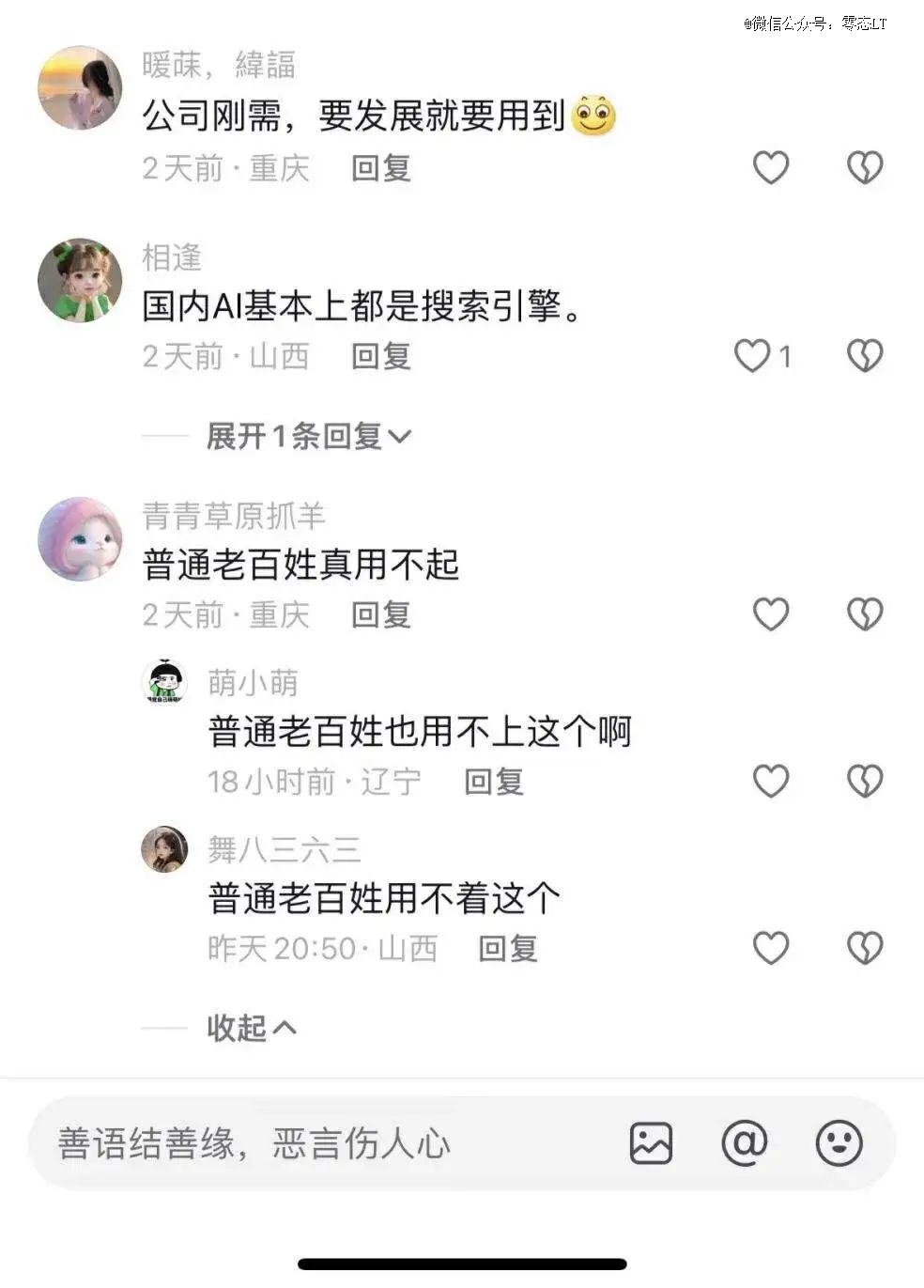

像网约车大战时用户能极低价格打车一样,每次价格大战都是消费者再次收割红利的时候,但不同的是,此次大模型的降价也许受益者并不是普通消费者。

一直以来,大模型面临的尴尬是:用户增长乏力不可避免,写复杂的提示词仍然是普通用户*的障碍。目前面向C端的主要是各手机厂商植入式的AI助手,但这些AI工具难以从消费者手中变现。

▲图:大模型降价消息下网友的评论内容

大模型降价究竟谁能得利?

透过AIGC 产业链中各层级关系来看,目前位于产业*层的是基础设施层,核心是支撑算力的AI服务器,如CPU、GPU等,这一产业领域以英伟达和AMD为代表;往上是需要诸多*科学家进行长时期投入的模型层,国外的OpenAI和Google以及国内大厂目前主要在这一领域竞争。基于大模型的应用层,则是致力于解决C端用户的消费终端以及为B端用户提供行业解决方案。

对于大模型行业来说,仅仅具有技术的先进性并不能带来应用的落地,如果不能降低大模型的推理成本,任何商业化都将是一种昂贵的尝试,尤其是C端应用,成本可能是个无底洞。

由此可见,大模型全面降价*的利好仍然是进行应用开发的中小企业,成本的降低有助于这一类企业的百花齐放。

以AI大模型为技术底座打造具有针对性的应用软件,最典型的就是今年*爆火的国产生成式AI产品Remini。丑萌搞怪的黏土风滤镜,一跃让Remini直接冲上了国内iOS免费APP下载榜榜首。Remini的爆火让人们想起了另一款图像生成软件妙鸭,仅用9.9元和20张日常照就可以生成自己的“数字分身”,效果堪比市场价数百元的艺术写真。和妙鸭一样,Remini的结局也许只是昙花一现,和那些不温不火的AI应用产品一起,让人不得不对生成式AI的商业化应用路径及其稳定性担忧。

▲图:AIGC产品商业化模式,国投证券研究中心

所以API贵是限制应用端发展的主要原因吗?显然不是。正如阿里巴巴原副总裁贾扬清所言,今天企业在使用AI时,并不是成本驱动的。企业如果搞不清怎样才能产生业务价值,再便宜也不过是一种浪费。

360董事长兼CEO也公开表示了自己对当下大模型产业的看法。他认为,公用大模型到应用大模型转变才是行业正确的思路。针对C端用户,需要找到用户需求进行个性化定制;另一方面为企业定制专业的大模型并进行私有化部署。“未来的企业内部应该拥有多个垂直大模型,这样的模型既要简约又要便于使用,提高企业内部效率。”例如,最近国产自研的聚焦财税领域的垂类大模型——BPai财税大模型。

既要抓模型技术,又要抓商业应用,价格战之后的路还很远。

“便宜赢得不了商战,谁能落地获得利润才是笑到最后。”

【本文由投资界合作伙伴微信公众号:零态LT授权发布,本平台仅提供信息存储服务。】如有任何疑问,请联系(editor@zero2ipo.com.cn)投资界处理。