3 月 21 日晚上 11 点,英伟达 CEO 黄仁勋的演讲,为 GTC 2023 拉开序幕。

ChatGPT 和 GPT-4 掀起这股生成式 AI 热潮后,为 AI 提供心脏的英伟达成了背后的大赢家,也让今年的 GTC 注定成为有史以来最受关注的一届。

黄仁勋没有让关注者失望。

「AI 的 iPhone 时刻已经到来。」70 分钟的演讲里,老黄重复了四五遍。

每次讲这句话前,他都会分享一项关于生成式 AI 的新进展——对创作、医疗、工业等领域的革命,让普通人用浏览器就能训练大模型的云服务,以及让大模型处理成本下降 10 倍的超级芯片……

「AI 的发展会超过任何人的想象。」这句话是对这场演讲*的注脚。

01、让大语言模型的处理成本下降一个数量级

2012 年,Alex Kerchevsky、Ilya Suskever 和他们的导师 Geoff Hinton 在两块 GeForce GTX 580 上,使用 1400 万张图像训练了 AlexNet——这被认为是这一轮 AI 革命的开端,因为它首次证明了 GPU 可以用于训练人工智能。

4 年后,黄仁勋亲手向 OpenAI 交付了*台 NVIDIA DGX 超级计算机。此后数年,OpenAI 在大型语言模型上的突破让 AIGC 开始进入人们的视野,并在去年年底推出 ChatGPT 后彻底破圈。几个月内这个对话式 AI 产品吸引了超过 1 亿用户,成为历史上增长最快的 App。

NVIDIA DGX 最初被用作 AI 的研究设备,现在已经被企业广泛用于优化数据和处理 AI。根据黄仁勋,财富 100 强公司中有一半安装了 DGX。

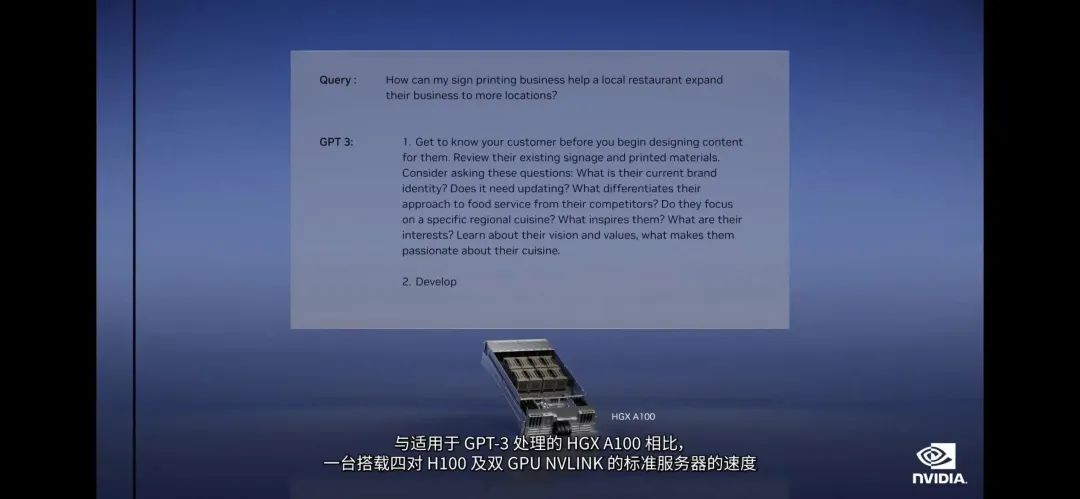

在这之中,部署像 ChatGPT 这样的 LLM 正在成为 DGX 越来越重要的一项工作。对此,黄仁勋宣布了一种新的 GPU——带有双图形处理器 NVLink 的 H100 NVL。

基于英伟达的 Hopper 架构,H100 采用 Transformer 引擎,被设计用于专门处理类似 GPT 这样的模型。与用于 GPT-3 处理的 HGX A100 相比,一个搭载四对 H100 和 NVLINK 的标准服务器的处理速度快 10 倍。根据官网数据,H100 的综合技术创新。可以将大型语言模型的速度提高 30 倍。

「H100 可以将大型语言模型处理成本降低一个数量级,」黄仁勋说到。

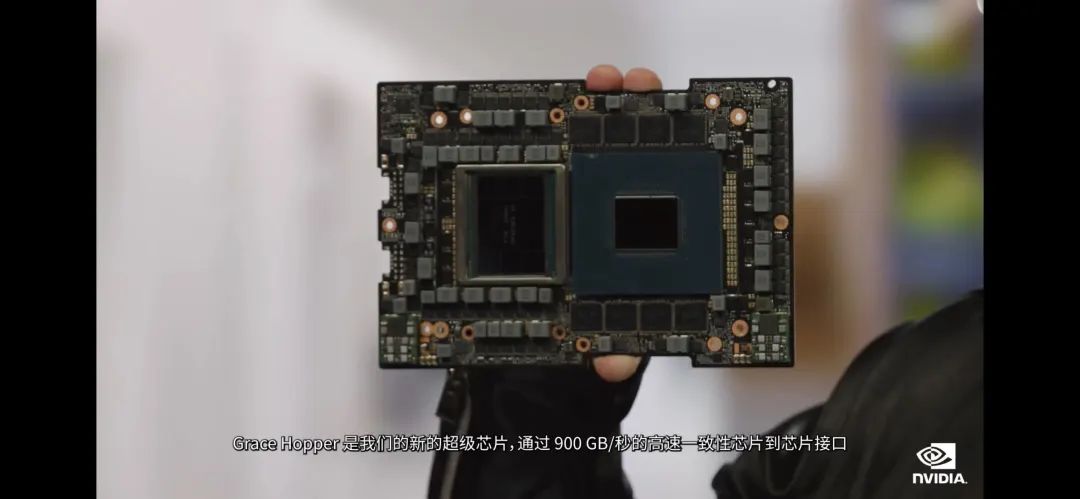

此外,在过去的十年里,云计算每年增长 20%,成为一个 1 万亿美元的行业。为了 AI 和 云计算,英伟达设计了 Grace CPU,在新的架构下,GPU 负责处理 AI 的工作负载,Grace CPU 负责采样,二者之间通过一个 900 GB/s 的高速传输设备连接在一起。

「Grace-Hopper 是处理大规模数据集的*选择。」黄仁勋称,「我们的客户希望建立训练数据大几个数量级的 AI 大模型,Grace-Hopper 是理想的引擎。」

某种意义上来说,计算成本已经成为今天阻碍生成式 AI 发展的核心问题,OpenAI 为此烧掉了数十亿乃至上百亿美元,微软也出于成本考虑始终没有向更大范围的公众开放新 Bing,甚至限制用户每天的对话次数。

英伟达此时推出更高效的算力方案,无疑是给行业解决了一个大难题。

02、DGX Cloud:让任何企业

都能构建 AI 能力

今年 GTC 上另一个涉及生成式 AI 的重点,就是 DGX Cloud。

实际上,这并不是英伟达*次公布 DGX Cloud。此前英伟达四季报发布时,黄仁勋就向外界透露英伟达将与云服务厂商展开合作,让客户可以使用网页浏览器,就能通过 NVIDIA DGX Cloud 来使用 DGX 计算机,从而训练和部署大型语言模型或完成其他 AI 工作负载。

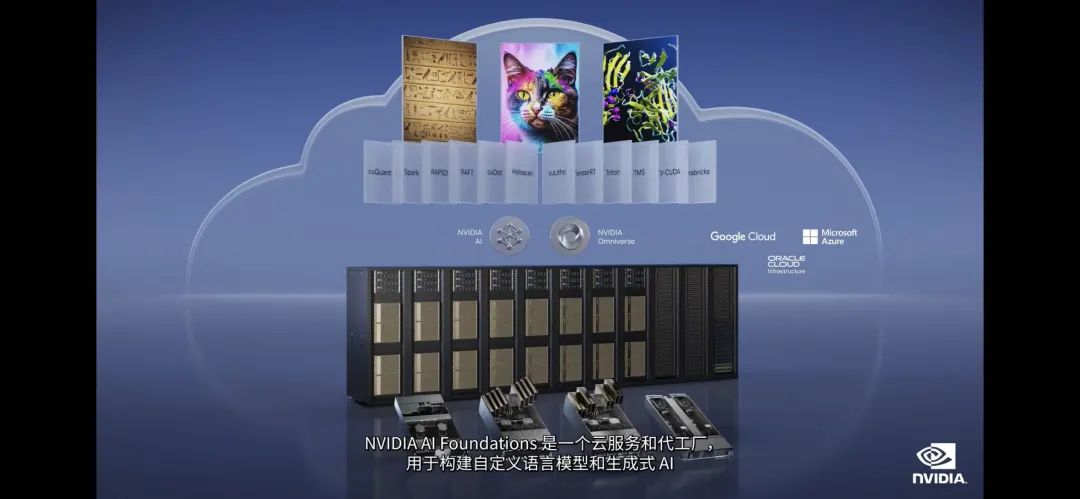

英伟达已经与甲骨文展开合作,预计下个季度微软 Azure 也会开始托管 DGX 云,而谷歌云也将在不久之后加入这一行列,以托管的方式向那些有意愿构建新产品和发展 AI 战略的企业提供 DGX 云服务。

黄仁勋称,这种合作关系将英伟达的生态系统带到了云服务商手中,同时扩大了英伟达的市场规模和覆盖面。企业将能够每月租用 DGX 云集群,确保他们能够快速轻松地扩展大型多节点 AI 训练。

03、ChatGPT 只是开始

「加速计算是曲速引擎,AI 就是它的能源。」黄仁勋说道,「生成式 AI 日新月异的能力,给我们重新构想其产品和商业模式带来了紧迫感。」

ChatGPT 和 GPT-4 为代表的大语言模型在过去几个月火遍全球,但对英伟达来说,ChatGPT 和大模型并不是 AI 的全部。会上,黄仁勋还分享了更多英伟达在 AI 领域的探索和他本人的观察。

首先是最火的生成式 AI。

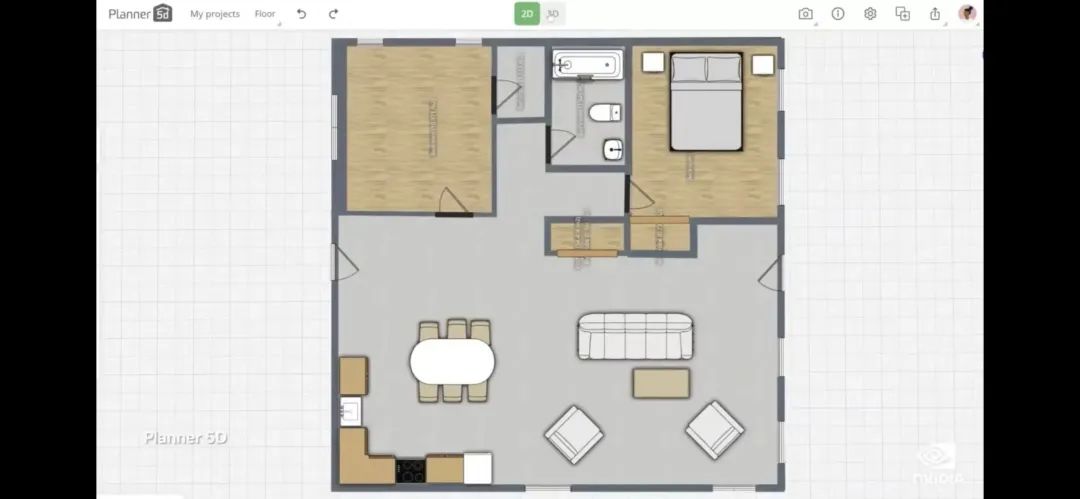

只需要一张手绘的草图,就能生成 3D 建模的户型。

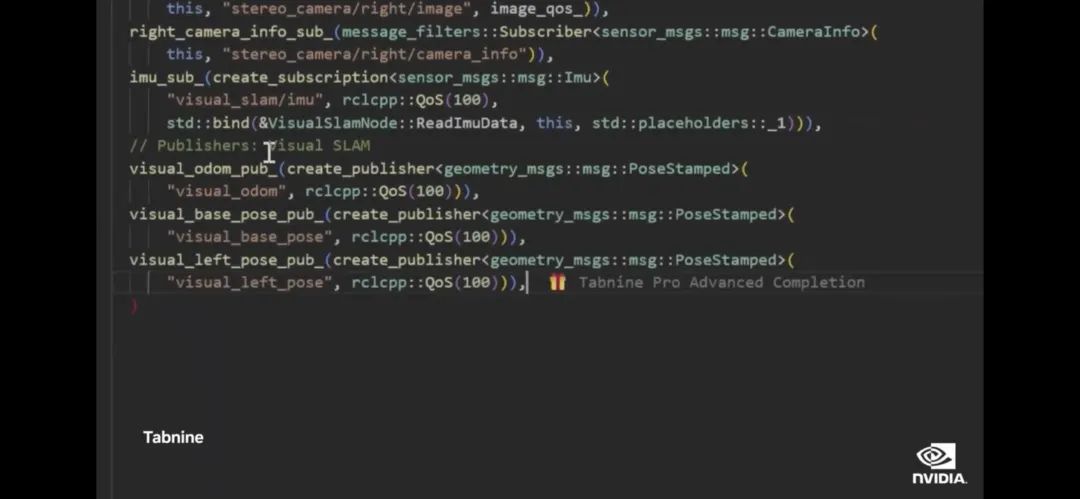

撰写代码也不在话下。

还有创作音乐。

为了加速那些寻求利用生成 AI 的人的工作,英伟达宣布成立 NVIDIA AI Foundations,这是一个云服务和代工厂,面向需要构建、改进和定制 LLM 和生成式 AI 的用户,这些客户使用其专有数据训练特定领域的 AI。

AI Foundations 的服务包括 NVIDIA NeMo,用于构建文本-文本的生成模型;毕加索,一种视觉语言模型制作服务,面向希望构建基于经授权内容训练模型的用户;以及 BioNeMo,帮助生物医药研究人员。

作为生产力工具,AI 也在发挥巨大的价值,黄仁勋在演讲中介绍了几个非常有意思的案例。

*个是与美国电信巨头 AT&T。AT&T 需要定期派遣 3 万名技术人员,为 700 个区域的 1300 万名客户提供服务。这个庞大的数据,调度是一个痛点,如果在 CPU 上运行,调度优化需要一整夜的时间才能完成。

借助英伟达的 CuOpt,AT&T 可以将调度方案的优化时间加快 100 倍,并可实时更新其调度方案。

某种意义上,在英伟达的帮助下,AT&T 做到了美团、滴滴这些需要实时匹配的互联网公司用好多年积累才做到的事情。

另一个案例是与芯片公司的合作。大多数人都知道了光刻机这个半导体产业的关键设备。但鲜为人知的是,随着制程技术的发展,芯片设计对算力的需求也是半导体行业的一大痛点。

今天计算光刻是芯片设计和制造领域*的计算工作负载,每年需要消耗数百亿 CPU 小时,并且随着算法越来越复杂,计算光刻的成本也在提高。

对此,英伟达宣布推出 cuLitho——一个计算光刻库。并与 ASML、台积电等巨头展开合作,从而大幅降低芯片设计过程中的算力消耗,节能减排。

事实上,减少能源消耗,提高计算效率,是黄仁勋眼中 AI 技术将为人类社会带来的另一大价值。而在摩尔定律失效的当下,加速计算和 AI 的到来恰逢其时。

「各行业正都在面对可持续发展、生成式 AI 和数字化的挑战。工业公司正在竞相数字化,并重塑为软件驱动的科技公司——成为颠覆者,而不是被颠覆者,」加速计算让这些公司可以应对这些挑战,黄仁勋说道。「加速计算是减少电力消耗、实现可持续性发展和碳中和的*方式。」

最后,类似于一个彩蛋,从老黄此次演讲的表现不难猜测,视频中出现的老黄,应该全程是一个虚拟形象。如无意外,很有可能也是「生成式 AI」的产物——在表现 AI 进步的同时,也算是黄仁勋为自己家「核弹算力」再次「现身说法」。

【本文由投资界合作伙伴微信公众号:极客公园授权发布,本平台仅提供信息存储服务。】如有任何疑问,请联系(editor@zero2ipo.com.cn)投资界处理。